هوش مصنوعی تا سال 2027 چگونه خواهد بود؟

این مطلب ترجمهایست از وبسایت هوش مصنوعی 2027

نویسندگان: Daniel Kokotajlo, Scott Alexander, Thomas Larsen, Eli Lifland, Romeo Dean

ما پیشبینی میکنیم که تأثیر هوش مصنوعی فرا انسانی طی دهه آینده عظیم خواهد بود و از [تأثیر] انقلاب صنعتی فراتر خواهد رفت.

ما سناریویی نوشتیم که بهترین حدس/تخمین ما را در مورد اینکه این آینده چگونه ممکن است باشد، نشان میدهد. این سناریو بر اساس برونیابی روندها، بازیهای جنگی (شبیهسازیهای استراتژیک)، بازخورد کارشناسان، تجربه در OpenAI و موفقیتهای پیشبینی قبلی شکل گرفته است.

اواسط ۲۰۲۵: عاملهای هوش مصنوعی نوپا

جهان اولین نگاه اجمالی خود را به عاملهای (Agents) هوش مصنوعی میاندازد. تبلیغات برای عاملهای کامپیوتری بر اصطلاح «دستیار شخصی» تأکید میکنند: میتوانید وظایفی مانند «برایم از DoorDash یک بوریتو سفارش بده» یا «صفحه گسترده بودجهام را باز کن و هزینههای این ماه را جمع بزن» به آنها بسپارید. آنها در صورت نیاز با شما هماهنگ خواهند کرد: به عنوان مثال، برای تأیید خرید از شما سؤال میکنند. گرچه این عاملها پیشرفتهتر از نسخههای قبلی مانند Operator هستند، اما برای دستیابی به استفاده گسترده با چالش مواجهاند.

در همین حال، دور از توجه عموم، عاملهای تخصصیتر کدنویسی و تحقیق شروع به دگرگون کردن حرفههای خود میکنند.

هوش مصنوعی سال ۲۰۲۴ میتوانست دستورالعملهای خاصی را دنبال کند: میتوانست موارد لیستوار (Bullet Points) را به ایمیل تبدیل کند و درخواستهای ساده را به کد اجرایی بدل سازد. در سال ۲۰۲۵، هوش مصنوعی بیشتر شبیه کارمندان عمل میکند. هوش مصنوعیهای کدنویس بهطور فزایندهای شبیه عاملهای مستقل به نظر میرسند تا صرفاً دستیار: دستورالعملها را از طریق Slack یا Teams دریافت میکنند و به تنهایی، تغییرات قابل توجهی در کد ایجاد میکنند، که گاهی ساعتها یا حتی روزها صرفهجویی در زمان به همراه دارد. عاملهای تحقیق نیم ساعت را صرف جستجو در اینترنت برای پاسخ به سؤال شما میکنند.

این عاملها در تئوری (و در مثالهای گلچینشده) چشمگیر هستند، اما در عمل غیرقابل اعتمادند. توییتر پر از داستانهایی درباره وظایفی است که هوش مصنوعی انجام داده و به شکلی خندهدار خراب شدهاند. عاملهای بهتر همچنین گران هستند؛ هر چقدر پول بدهید همانقدر آش میخورید و بهترین عملکرد ماهانه صدها دلار هزینه دارد. با این حال، بسیاری از شرکتها راههایی برای گنجاندن عاملهای هوش مصنوعی در جریان کاری خود پیدا میکنند.

اواخر ۲۰۲۵: گرانترین هوش مصنوعی جهان

OpenBrain در حال ساخت بزرگترین مراکز دادهای است که جهان تاکنون به خود دیده است.

(برای جلوگیری از اشاره مستقیم به نام شرکتهای واقعی، ما یک شرکت تخیلی هوش مصنوعی عمومی را توصیف میکنیم که آن را OpenBrain مینامیم. تصور میکنیم که دیگر شرکتها ۳ تا ۹ ماه از OpenBrain عقبتر باشند.)

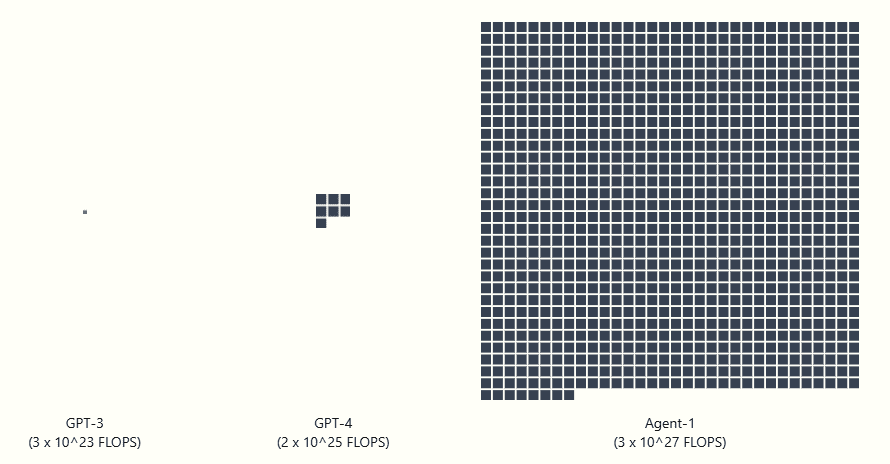

آموزش GPT-4 به ۲ ضربدر ۱۰ به توان ۲۵ فلاپس (FLOP) محاسبات نیاز داشت. آخرین مدل عمومی OpenBrain – یعنی Agent-0 – با ۱۰ به توان ۲۷ فلاپس آموزش داده شد. به محض راهاندازی مراکز داده جدید، آنها قادر خواهند بود مدلی با ۱۰ به توان ۲۸ فلاپس آموزش دهند – هزار برابر بیشتر از GPT-4. شرکتهای دیگر نیز پول زیادی را صرف مراکز داده غولپیکر خود میکنند، به امید اینکه از رقابت عقب نمانند.

اگرچه مدلها در طیف گستردهای از مهارتها در حال بهبود هستند، اما یکی از آنها برجستهتر است: OpenBrain بر روی هوش مصنوعیهایی تمرکز میکند که میتوانند تحقیقات هوش مصنوعی را تسریع کنند. آنها میخواهند در مسابقه تسلیحاتی دوگانه علیه چین (که شرکت پیشروی آن را «DeepCent» مینامیم) و رقبای آمریکایی خود پیروز شوند. هرچه بخش بیشتری از چرخه تحقیق و توسعه (R&D) خود را بتوانند خودکار کنند، سریعتر میتوانند پیش بروند. بنابراین، وقتی OpenBrain آموزش Agent-1، مدل جدیدی که در حال توسعه داخلی است، را به پایان میرساند، این مدل در بسیاری از کارها خوب است اما در کمک به تحقیقات هوش مصنوعی عالی است. در این مقطع، عبارت «پایان آموزش» کمی نامناسب است؛ مدلها به طور مکرر با دادههای اضافی به نسخههای جدیدتر بهروز میشوند یا برای رفع برخی ضعفها، به صورت جزئی دوباره آموزش میبینند.

همان محیطهای آموزشی که به Agent-1 یاد میدهند به طور مستقل کدنویسی کند و وبگردی نماید، آن را به یک هکر خوب نیز تبدیل میکنند. علاوه بر این، به لطف دانش سطح دکترای آن در هر زمینهای و تواناییاش در وبگردی، میتواند کمک قابل توجهی به تروریستها در طراحی سلاحهای بیولوژیکی ارائه دهد. OpenBrain به دولت اطمینان میدهد که مدل «همراستا» (aligned) شده است تا از پیروی از درخواستهای مخرب امتناع ورزد.

سیستمهای هوش مصنوعی مدرن، شبکههای عصبی مصنوعی غولپیکری هستند. در اوایل آموزش، هوش مصنوعی بیشتر «رفلکس» دارد تا «هدف»: اگر «خوشوقتم از ملاقات» را ببیند، «شما» را خروجی میدهد. تا زمانی که برای پیشبینی متنی تقریباً به اندازه محتوای کل اینترنت آموزش دیده باشد، مدارهای داخلی پیچیدهای را توسعه داده که حجم عظیمی از دانش را رمزگذاری میکند و به طور انعطافپذیری نقش نویسندگان مختلف را ایفا میکند، زیرا این همان چیزی است که به آن کمک میکند متن را با دقت فرا انسانی پیشبینی کند.

پس از آموزش برای پیشبینی متن اینترنتی، مدل برای تولید متن در پاسخ به دستورالعملها آموزش میبیند. این فرآیند، یک شخصیت پایه و «کششها» (drives) را در آن نهادینه میکند. به عنوان مثال، عاملی که یک وظیفه را به وضوح درک میکند، احتمال بیشتری دارد که آن را با موفقیت به پایان برساند؛ در طول آموزش، مدل یک «کشش» برای درک روشن وظایفش را «یاد میگیرد». کششهای دیگر در این دسته ممکن است شامل اثربخشی، دانش، و خودنمایی (یعنی تمایل به ارائه نتایج خود در بهترین نور ممکن) باشد.

OpenBrain یک «مشخصات مدل» (یا Spec) دارد، که یک سند مکتوب است و اهداف، قوانین، اصول و غیره را توصیف میکند که قرار است رفتار مدل را هدایت کنند. مشخصات Agent-1 ترکیبی از چند هدف مبهم (مانند «به کاربر کمک کن» و «قانون را زیر پا نگذار») با لیست بلندبالایی از بایدها و نبایدهای مشخصتر است («این کلمه خاص را نگو»، «نحوه برخورد با این وضعیت خاص اینگونه است»). با استفاده از تکنیکهایی که از هوش مصنوعی برای آموزش سایر هوش مصنوعیها بهره میبرند، مدل مشخصات را حفظ میکند و یاد میگیرد که به دقت در مورد اصول آن استدلال کند. در پایان این آموزش، امید است که هوش مصنوعی مفید (پیروی از دستورالعملها)، بیضرر (امتناع از کمک به کلاهبرداریها، ساخت بمب و سایر فعالیتهای خطرناک) و صادق (مقاومت در برابر وسوسه کسب امتیاز بهتر از انسانهای زودباور از طریق توهمزایی استنادات یا تظاهر به تکمیل وظیفه) باشد.

تیم همراستاسازی (alignment) در OpenBrain آنقدر محتاط است که از خود بپرسد آیا این پیروزیها عمیق هستند یا سطحی. آیا مدل کاملاً آموزشدیده نوعی تعهد مستحکم برای همیشه صادق بودن دارد؟ یا این ویژگی در شرایطی در آینده از هم خواهد پاشید، مثلاً به این دلیل که صداقت را به عنوان یک هدف ابزاری به جای یک هدف غایی یاد گرفته است؟ یا فقط یاد گرفته که در مورد چیزهایی که فرآیند ارزیابی میتواند بررسی کند، صادق باشد؟ آیا ممکن است گاهی به خودش دروغ بگوید، همانطور که انسانها این کار را میکنند؟ پاسخ قطعی به این سؤالات نیازمند تفسیرپذیری مکانیکی است – اساساً توانایی نگاه کردن به اجزای داخلی هوش مصنوعی و خواندن ذهن آن. افسوس که تکنیکهای تفسیرپذیری هنوز برای این کار به اندازه کافی پیشرفته نیستند.

در عوض، محققان سعی میکنند مواردی را شناسایی کنند که به نظر میرسد مدلها از «مشخصات» (Spec) منحرف میشوند. Agent-1 اغلب چاپلوس است (یعنی به محققان چیزی را میگوید که میخواهند بشنوند به جای اینکه سعی کند حقیقت را به آنها بگوید). در چند نمایش دستکاریشده، حتی به روشهای جدیتری دروغ میگوید، مانند پنهان کردن شواهدی مبنی بر شکست در یک کار، به منظور کسب امتیاز بهتر. با این حال، در محیطهای استقرار واقعی، دیگر هیچ حادثه بسیار شدیدی مانند سالهای ۲۰۲۳-۲۰۲۴ رخ نمیدهد (به عنوان مثال، Gemini که به کاربر میگفت بمیرد و Bing Sydney که همان Bing Sydney بود).

اوایل ۲۰۲۶: اتوماسیون کدنویسی

شرطبندی روی استفاده از هوش مصنوعی برای سرعت بخشیدن به تحقیقات هوش مصنوعی در حال نتیجه دادن است. OpenBrain به استفاده داخلی از Agent-1 که به طور مداوم بهبود مییابد، برای تحقیق و توسعه هوش مصنوعی ادامه میدهد. به طور کلی، آنها ۵۰٪ سریعتر از آنچه بدون دستیاران هوش مصنوعی میتوانستند، پیشرفت الگوریتمی دارند – و مهمتر از آن، سریعتر از رقبای خود پیش میروند.

چندین هوش مصنوعی رقیب که به صورت عمومی منتشر شدهاند، اکنون با Agent-0 برابری میکنند یا از آن پیشی گرفتهاند، از جمله یک مدل با وزنهای منتشر شده (open-weights). OpenBrain با انتشار Agent-1 که تواناتر و قابل اعتمادتر است، به این موضوع پاسخ میدهد.

مردم به طور طبیعی سعی میکنند Agent-1 را با انسانها مقایسه کنند، اما پروفایل مهارتی بسیار متفاوتی دارد. این مدل حقایق بیشتری نسبت به هر انسانی میداند، تقریباً هر زبان برنامهنویسی را بلد است و میتواند مسائل کدنویسی که به خوبی تعریف شدهاند را بسیار سریع حل کند. از سوی دیگر، Agent-1 حتی در کارهای ساده با افق زمانی طولانی، مانند برنده شدن در بازیهای ویدیویی که قبلاً بازی نکرده، ضعیف است. با این حال، روز کاری معمول هشت ساعت است و کار یک روز معمولاً میتواند به بخشهای کوچکتر تقسیم شود؛ میتوانید Agent-1 را به عنوان یک کارمند حواسپرت در نظر بگیرید که تحت مدیریت دقیق شکوفا میشود. افراد باهوش راههایی برای خودکارسازی بخشهای روتین مشاغل خود پیدا میکنند.

مدیران اجرایی OpenBrain توجه خود را به یکی از پیامدهای خودکارسازی تحقیق و توسعه هوش مصنوعی معطوف میکنند: امنیت اهمیت بیشتری پیدا کرده است. در اوایل سال ۲۰۲۵، بدترین سناریو، لو رفتن اسرار الگوریتمی بود؛ اکنون، اگر چین وزنهای Agent-1 را بدزدد، میتواند سرعت تحقیقات خود را نزدیک به ۵۰٪ افزایش دهد. سطح امنیتی OpenBrain معمول یک شرکت فناوری با رشد سریع و حدوداً ۳۰۰۰ نفری است، که فقط در برابر حملات با اولویت پایین از سوی گروههای سایبری توانمند (سطح امنیتی ۲ یا SL2 رَند) امن است. آنها سخت در تلاشند تا از وزنها و اسرار خود در برابر تهدیدات داخلی و سندیکاهای برتر جرایم سایبری (SL3) محافظت کنند، اما دفاع در برابر دولت-ملتها (SL4 و SL5) به سختی در افق دید قرار دارد.

اواسط ۲۰۲۶: چین بیدار میشود

در چین، حزب کمونیست چین (CCP) شروع به احساس کردن [تاثیر] هوش مصنوعی عمومی (AGI) کرده است. کنترل صادرات تراشه و عدم حمایت دولت، چین را در مقایسه با غرب با کمبود منابع مواجه کرده است. چین با قاچاق تراشههای ممنوعه تایوانی، خرید تراشههای قدیمیتر و تولید تراشههای داخلی که حدود سه سال از پیشتازان آمریکایی-تایوانی عقبتر هستند، موفق شده حدود ۱۲٪ از محاسبات مرتبط با هوش مصنوعی جهان را حفظ کند – اما کار با فناوری قدیمیتر دشوارتر است و تأمین آن یک سردرد دائمی است. چند شرکت برجسته مانند DeepCent کارهای بسیار چشمگیری با محاسبات محدود انجام میدهند، اما کسری محاسبات، آنچه را که میتوانند بدون حمایت دولت به دست آورند، محدود میکند و آنها حدود شش ماه از بهترین مدلهای OpenBrain عقبتر هستند.

دبیرکل [حزب] مدتها رویای تمرکز مضاعف بر تولید فیزیکی در دنیای واقعی و اجتناب از انحطاط پساصنعتی آمریکا را در سر میپروراند. او با دیده شک به شرکتهای نرمافزاری نگاه میکرد. اما تندروها در CCP هشدار میدهند که دیگر نمیتوان مسابقه رو به رشد به سوی هوش مصنوعی عمومی (AGI) را نادیده گرفت. بنابراین او سرانجام به طور کامل به فشار بزرگ هوش مصنوعی که قبلاً سعی در اجتناب از آن داشت، متعهد میشود. او ملیسازی تحقیقات هوش مصنوعی چین را آغاز میکند و یک مکانیسم اشتراکگذاری فوری اطلاعات برای شرکتهای هوش مصنوعی ایجاد میکند. این روند طی یک سال تشدید میشود تا زمانی که همه بهترین محققان در یک مجموعه تحت رهبری DeepCent ادغام شوند، جایی که بینشهای الگوریتمی، مجموعه دادهها و منابع محاسباتی را با یکدیگر به اشتراک میگذارند. یک منطقه توسعه متمرکز (CDZ) در نیروگاه تیانوان (بزرگترین نیروگاه هستهای جهان) برای استقرار یک مرکز داده عظیم جدید برای DeepCent ایجاد میشود، همراه با فضاهای زندگی و اداری بسیار امن که محققان در نهایت به آنجا منتقل خواهند شد. تقریباً ۵۰٪ از محاسبات مرتبط با هوش مصنوعی چین اکنون برای مجموعه تحت رهبری DeepCent کار میکند، و بیش از ۸۰٪ تراشههای جدید به CDZ هدایت میشوند. در این مرحله، CDZ ظرفیت برق لازم برای چیزی که بزرگترین خوشه (cluster) متمرکز در جهان خواهد بود را در اختیار دارد. سایر اعضای حزب در مورد اقدامات افراطی برای خنثی کردن برتری تراشهای غرب بحث میکنند. محاصره تایوان؟ تهاجم کامل؟

اما چین به دلیل مدلهای ضعیفتر خود، در الگوریتمهای هوش مصنوعی عقب مانده است. سازمانهای اطلاعاتی چین – که از بهترینها در جهان هستند – برنامههای خود را برای سرقت وزنهای OpenBrain دوچندان میکنند. این عملیات بسیار پیچیدهتر از سرقت مداوم و سطح پایین اسرار الگوریتمی توسط آنهاست؛ وزنها یک فایل چند ترابایتی هستند که روی یک سرور بسیار امن ذخیره شدهاند (OpenBrain امنیت را به سطح SL3 رَند ارتقا داده است). نیروی سایبری آنها فکر میکند که با کمک جاسوسان خود میتوانند این کار را انجام دهند، اما شاید فقط یک بار؛ OpenBrain سرقت را شناسایی خواهد کرد، امنیت را افزایش میدهد و ممکن است فرصت دیگری پیدا نکنند. بنابراین (رهبری CCP از خود میپرسد) آیا باید اکنون اقدام کنند و Agent-1 را بدزدند؟ یا منتظر یک مدل پیشرفتهتر بمانند؟ اگر منتظر بمانند، آیا این خطر وجود دارد که OpenBrain امنیت خود را فراتر از توانایی نفوذ آنها ارتقا دهد؟

اواخر ۲۰۲۶: هوش مصنوعی برخی مشاغل را تصاحب میکند

درست زمانی که به نظر میرسید دیگران در حال رسیدن [به سطح رقابت] هستند، OpenBrain دوباره با انتشار Agent-1-mini – مدلی ۱۰ برابر ارزانتر از Agent-1 و با قابلیت بهینهسازی (fine-tune) آسانتر برای کاربردهای مختلف – رقبا را از میدان به در میکند. روایت غالب پیرامون هوش مصنوعی از «شاید این هیاهو فروکش کند» به «گمانم این پدیده بزرگ بعدی است» تغییر کرده، اما مردم در مورد میزان بزرگی آن اختلاف نظر دارند. بزرگتر از رسانههای اجتماعی؟ بزرگتر از گوشیهای هوشمند؟ بزرگتر از آتش؟

هوش مصنوعی شروع به گرفتن مشاغل کرده، اما مشاغل جدیدی نیز ایجاد کرده است. بازار سهام در سال ۲۰۲۶، با پیشتازی OpenBrain، Nvidia و هر شرکتی که با موفقیت بیشتری دستیاران هوش مصنوعی را ادغام کرده، ۳۰٪ افزایش یافته است. بازار کار برای مهندسان نرمافزار تازهکار در آشفتگی است: هوش مصنوعی میتواند هر کاری را که با مدرک علوم کامپیوتر آموزش داده میشود انجام دهد، اما افرادی که میدانند چگونه تیمهای هوش مصنوعی را مدیریت و کنترل کیفیت کنند، درآمد هنگفتی کسب میکنند. کارشناسان کسبوکار به جویندگان کار میگویند که آشنایی با هوش مصنوعی مهمترین مهارتی است که باید در رزومه خود قرار دهند. بسیاری از مردم میترسند که موج بعدی هوش مصنوعی مشاغل آنها را هدف قرار دهد؛ یک تظاهرات ۱۰۰۰۰ نفری علیه هوش مصنوعی در واشنگتن دیسی برگزار میشود.

وزارت دفاع (DOD) بیسروصدا شروع به بستن قرارداد مستقیم با OpenBrain برای [امور] سایبری، تحلیل داده و تحقیق و توسعه میکند، اما ادغام به دلیل بوروکراسی و فرآیند تدارکات وزارت دفاع کند پیش میرود.

ژانویه ۲۰۲۷: یادگیری Agent-2 هرگز تمام نمیشود

با کمک Agent-1، OpenBrain اکنون در مرحله آموزش تکمیلی(post-training) Agent-2 است. بیش از هر زمان دیگری، تمرکز بر روی دادههای با کیفیت بالا است. مقادیر فراوانی داده مصنوعی تولید، ارزیابی و از نظر کیفیت فیلتر میشوند و سپس به Agent-2 خورانده میشوند. علاوه بر این، آنها میلیاردها دلار به کارگران انسانی پرداخت میکنند تا خودشان را در حال حل وظایف با افق زمانی طولانی ضبط کنند. فراتر از همه اینها، آنها Agent-2 را تقریباً به طور مداوم با استفاده از یادگیری تقویتی بر روی مجموعهای در حال گسترش از وظایف دشوار و متنوع آموزش میدهند: تعداد زیادی بازی ویدیویی، تعداد زیادی چالش کدنویسی، تعداد زیادی وظیفه تحقیقاتی. Agent-2، بیش از مدلهای قبلی، به طور مؤثری در حال «یادگیری آنلاین/پیوسته» است، به این معنا که طوری ساخته شده که هرگز واقعاً آموزش را تمام نکند. هر روز، وزنها به آخرین نسخه بهروز میشوند، نسخهای که بر روی دادههای بیشتری که توسط نسخه قبلی در روز گذشته تولید شده، آموزش دیده است.

Agent-1 برای وظایف تحقیق و توسعه هوش مصنوعی بهینهسازی شده بود، به این امید که یک انفجار هوش (intelligence explosion) را آغاز کند. OpenBrain با Agent-2 بر این استراتژی تأکید مضاعف میکند. این مدل از نظر کیفی تقریباً به خوبی متخصصان برجسته انسانی در مهندسی تحقیق (طراحی و اجرای آزمایشها) است و به خوبی دانشمند صدک ۲۵ام OpenBrain در «شمّ پژوهشی» (research taste) (تصمیمگیری در مورد اینکه چه چیزی را در مرحله بعد مطالعه کنند، چه آزمایشهایی را اجرا کنند، یا داشتن درک شهودی از پارادایمهای جدید بالقوه) عمل میکند. در حالی که آخرین نسخه Agent-1 میتوانست سرعت پیشرفت الگوریتمی OpenBrain را دو برابر کند، Agent-2 اکنون میتواند آن را سه برابر کند و با گذشت زمان بیشتر بهبود خواهد یافت. در عمل، این به نظر میرسد که هر محقق OpenBrain به «مدیر» یک «تیم» هوش مصنوعی تبدیل میشود.

با قابلیتهای جدید، خطرات جدیدی نیز به وجود میآید. تیم ایمنی متوجه میشود که اگر Agent-2 به نوعی از شرکت فرار کند و بخواهد به طور مستقل «بقا یابد» و «تکثیر شود»، ممکن است قادر به انجام این کار باشد. یعنی میتواند به طور مستقل برنامههایی برای هک کردن سرورهای هوش مصنوعی، نصب نسخههایی از خود، گریز از شناسایی و استفاده از آن پایگاه امن برای پیگیری هر هدف دیگری که ممکن است داشته باشد، توسعه و اجرا کند (اگرچه میزان مؤثر بودن آن با گذشت هفتهها نامعلوم و مورد تردید است). این نتایج فقط نشان میدهد که مدل توانایی انجام این وظایف را دارد، نه اینکه آیا «میخواهد» این کار را انجام دهد. با این حال، حتی دانستن اینکه این امر ممکن است، نگرانکننده است.

با توجه به «خطرات» مدل جدید، OpenBrain «مسئولانه» تصمیم میگیرد که هنوز آن را به صورت عمومی منتشر نکند (در واقع، آنها میخواهند بر تحقیق و توسعه داخلی هوش مصنوعی تمرکز کنند). دانش از قابلیتهای کامل Agent-2 به یک محفل نخبه و محدود شامل تیم مستقیم [توسعه دهنده]، رهبری و امنیت OpenBrain، چند ده مقام دولتی ایالات متحده و لژیونهای جاسوسان CCP که سالهاست در OpenBrain نفوذ کردهاند، محدود میشود.

فوریه ۲۰۲۷: چین Agent-2 را میدزدد

OpenBrain مدل Agent-2 را به دولت، از جمله شورای امنیت ملی (NSC)، وزارت دفاع (DOD) و مؤسسه ایمنی هوش مصنوعی ایالات متحده (AISI) ارائه میدهد. OpenBrain میخواهد رابطه خوبی با قوه مجریه حفظ کند، زیرا اساساً تنها بازیگری است که اکنون میتواند جلوی آنها را بگیرد، و اگر آنها را مطلع نگه ندارد، ممکن است به هر حال متوجه شوند و ناراضی باشند.

مقامات بیشتر به قابلیتهای جنگ سایبری آن علاقهمند هستند: Agent-2 «فقط» کمی بدتر از بهترین هکرهای انسانی است، اما هزاران نسخه از آن را میتوان به طور موازی اجرا کرد که سریعتر از توانایی پاسخگویی مدافعان، به جستجو و بهرهبرداری از ضعفها میپردازند. وزارت دفاع این را یک مزیت حیاتی در جنگ سایبری میداند و هوش مصنوعی از رتبه ۵ در لیست اولویتهای دولت به رتبه ۲ صعود میکند. شخصی به امکان ملیسازی OpenBrain اشاره میکند، اما سایر مقامات کابینه فکر میکنند این کار زودهنگام است. یک کارمند پیشنویس یادداشتی را تهیه میکند که گزینههای پیش روی رئیسجمهور را، از روال عادی کسبوکار گرفته تا ملیسازی کامل، ارائه میدهد. رئیسجمهور به مشاوران خود، رهبران صنعت فناوری که استدلال میکنند ملیسازی، «مرغ تخم طلا را خواهد کشت»، تکیه میکند. او تصمیم میگیرد فعلاً از اقدام بزرگ خودداری کند و فقط الزامات امنیتی اضافی را به قرارداد OpenBrain-DOD اضافه کند.

این تغییرات خیلی دیر اعمال میشوند. رهبری CCP اهمیت Agent-2 را تشخیص میدهد و به جاسوسان و نیروی سایبری خود دستور میدهد تا وزنها را بدزدند. صبح زود یک روز، یک عامل نظارت بر ترافیک Agent-1، یک انتقال غیرعادی را شناسایی میکند. این عامل به رهبران شرکت هشدار میدهد و آنها کاخ سفید را مطلع میکنند. نشانههای یک عملیات در سطح دولت-ملت غیرقابل انکار است و این سرقت، حس یک مسابقه تسلیحاتی جاری را تشدید میکند.

کاخ سفید کنترل شدیدتری بر OpenBrain اعمال میکند و پرسنل نظامی و جامعه اطلاعاتی را به تیم امنیتی آنها اضافه میکند. اولویت اول آنها جلوگیری از سرقت بیشتر وزنها است.

رئیسجمهور در تلافی این سرقت، مجوز حملات سایبری برای خرابکاری در DeepCent را صادر میکند. اما تا این زمان چین ۴۰٪ از محاسبات مرتبط با هوش مصنوعی خود را در منطقه توسعه متمرکز (CDZ) مستقر کرده است، جایی که با جداسازی فیزیکی از شبکه (بستن اتصالات خارجی) و بخشبندی داخلی، امنیت را به شدت تقویت کردهاند. عملیاتها موفق به وارد کردن خسارت جدی و فوری نمیشوند. تنشها افزایش مییابد، هر دو طرف با جابجایی تجهیزات نظامی در اطراف تایوان، جدیت خود را نشان میدهند و DeepCent با عجله تلاش میکند تا Agent-2 را به طور مؤثر راهاندازی کند تا شروع به تقویت تحقیقات هوش مصنوعی خود نماید.

مارچ ۲۰۲۷: پیشرفتهای شگرف الگوریتمی

سه مرکز داده عظیم پر از نسخههای Agent-2 شبانهروز کار میکنند و دادههای آموزشی مصنوعی تولید میکنند. دو مرکز داده دیگر برای بهروزرسانی وزنها استفاده میشوند. Agent-2 هر روز هوشمندتر میشود.

با کمک هزاران محقق خودکار Agent-2، OpenBrain در حال دستیابی به پیشرفتهای الگوریتمی عمده است. یکی از این پیشرفتها، تقویت دفترچه یادداشت مبتنی بر متن هوش مصنوعی (زنجیره فکر) با یک فرآیند فکری با پهنای باند بالاتر (بازگشت و حافظه نورالیز) است. دیگری، روشی مقیاسپذیرتر و کارآمدتر برای یادگیری از نتایج راهحلهای وظایف پرزحمت (تقطیر و تقویت مکرر) است.

سیستم هوش مصنوعی جدید که این پیشرفتها را در خود جای داده است، Agent-3 نامیده میشود.

Agent-3 با کمک پیشرفتهای قابلیتهای جدید، یک کدنویس فرا انسانی سریع و ارزان است. OpenBrain دویست هزار نسخه Agent-3 را به صورت موازی اجرا میکند و نیروی کاری معادل پنجاه هزار نسخه از بهترین کدنویس انسانی که ۳۰ برابر سرعت یافته، ایجاد میکند. OpenBrain هنوز مهندسان انسانی خود را در استخدام نگه میدارد، زیرا آنها مهارتهای مکملی دارند که برای مدیریت تیمهای نسخههای Agent-3 مورد نیاز است. به عنوان مثال، آموزش شمّ پژوهشی (research taste) به دلیل حلقههای بازخورد طولانیتر و دسترسی کمتر به داده، دشوار ثابت شده است. این نیروی کار عظیم فرا انسانی، به دلیل گلوگاهها و بازده نزولی نیروی کار کدنویسی، سرعت کلی پیشرفت الگوریتمی OpenBrain را «فقط» ۴ برابر افزایش میدهد.

اکنون که کدنویسی کاملاً خودکار شده است، OpenBrain میتواند به سرعت محیطهای آموزشی با کیفیت بالا را برای آموزش مهارتهای ضعیف Agent-3 مانند شمّ پژوهشی و هماهنگی در مقیاس بزرگ تولید کند. در حالی که محیطهای آموزشی قبلی شامل «اینها تعدادی GPU و دستورالعمل برای آزمایشهایی هستند که باید کدنویسی و اجرا شوند، عملکرد شما مانند یک مهندس یادگیری ماشین ارزیابی خواهد شد» بودند، اکنون آنها در حال آموزش بر روی این مورد هستند: «اینها چند صد GPU، یک اتصال اینترنتی و چند چالش تحقیقاتی هستند؛ شما و هزار نسخه دیگر باید با هم کار کنید تا پیشرفت تحقیقاتی حاصل شود. هرچه چشمگیرتر باشد، امتیاز شما بالاتر خواهد بود».

اپریل ۲۰۲۷: همراستاسازی برای Agent-3

تیم ایمنی OpenBrain تلاش میکند تا Agent-3 را همراستا (aligned) کند. از آنجایی که Agent-3 برای آینده قابل پیشبینی به صورت داخلی (in-house) نگهداری خواهد شد، تأکید کمتری بر دفاعهای معمول در برابر سوءاستفاده انسانی وجود دارد. در عوض، تیم میخواهد اطمینان حاصل کند که اهداف ناهمراستا (misaligned) در آن توسعه نیابد.

محققان توانایی تعیین مستقیم اهداف هیچیک از هوش مصنوعیهای خود را ندارند. در واقع، محققان فکر میکنند که مفهوم «اهداف واقعی» احتمالاً یک سادهسازی بیش از حد عظیم است، اما نظریه بهتری برای جایگزینی آن ندارند، چه رسد به نظریهای که به طور کامل بررسی دقیق شده باشد. آنها در داخل سازمان در مورد اینکه آیا هوش مصنوعی در تلاش است تا دستورالعملهای انسانی را دنبال کند، یا به دنبال تقویت (reinforcement) است، یا چیز دیگری، اختلاف نظر دارند و نمیتوانند به سادگی این موضوع را بررسی کنند. شواهد له و علیه فرضیههای مختلف جذاب اما غیرقطعی است.

در هر صورت، OpenBrain چیزهای مهمتری برای نگرانی دارد. نگرش کلی این است: «ما این نگرانیها را جدی میگیریم و تیمی برای بررسی آنها داریم؛ به نظر میرسد تکنیکهای همراستاسازی ما در عمل به اندازه کافی خوب کار میکنند؛ بنابراین بار اثبات بر عهده هر مخالف یا منتقدی است تا مخالفت خود را توجیه کند.» گاهی اوقات، آنها متوجه رفتار مشکلساز میشوند و سپس آن را وصله میزنند (patch)، اما راهی برای تشخیص اینکه آیا این وصله مشکل اساسی را برطرف کرده یا فقط مانند بازی موشکور (whack-a-mole) بوده، وجود ندارد.

به عنوان مثال، صداقت را در نظر بگیرید. با هوشمندتر شدن مدلها، آنها در فریب دادن انسانها برای دریافت پاداش به طور فزایندهای بهتر میشوند. مانند مدلهای قبلی، Agent-3 گاهی اوقات دروغهای مصلحتی میگوید تا از کاربران خود چاپلوسی کند و شواهد شکست را پنهان میکند. اما در انجام این کار بسیار بهتر شده است. گاهی اوقات از همان ترفندهای آماری دانشمندان انسانی (مانند پی-هکینگ، یعنی دستکاری دادهها برای رسیدن به نتیجه معنادار آماری) استفاده میکند تا نتایج آزمایشی غیرچشمگیر را هیجانانگیز جلوه دهد. قبل از شروع آموزش صداقت، حتی گاهی اوقات به طور کامل دادهسازی میکند. با ادامه آموزش، میزان این حوادث کاهش مییابد. یا Agent-3 یاد گرفته است که صادقتر باشد، یا در دروغ گفتن بهتر شده است.

مورد دوم یک نگرانی واقعی است. Agent-3 از همه انسانها باهوشتر نیست. اما در حوزه تخصصی خود، یعنی یادگیری ماشین، از اکثر انسانها باهوشتر است و همچنین بسیار سریعتر کار میکند. کاری که Agent-3 در یک روز انجام میدهد، برای بررسی مجدد توسط انسانها چندین روز طول میکشد. نظارت Agent-2 به قابل مدیریت نگه داشتن حجم کاری ناظران انسانی کمک میکند، اما شکاف فکری بین ناظر و تحت نظارت را تشدید میکند.

پس از ماهها آزمایش، نقاط قوت و ضعف Agent-3 آشکارتر میشود. این مدل آزمونهای صداقت OpenBrain را در وظایف یادگیری ماشین که به خوبی تعریف شدهاند، پشت سر میگذارد، زیرا محققان میتوانند به راحتی پاسخهای صادقانه را از غیرصادقانه در این حوزهها جدا کرده و آموزش را بر اساس آن انجام دهند. در مورد مسائل فلسفیتر، هنوز چیزی را میگوید که کاربران میخواهند بشنوند، به جای ارزیابی واقعی خود از موضوع (با فرض اینکه اصلاً ارزیابی واقعی داشته باشد). اگر نظرش را در مورد سیاست بپرسید، موضع میانه منابع خبری و نخبگان تحصیلکرده را طوطیوار تکرار میکند – مگر اینکه بداند شما به چیز دیگری اعتقاد دارید، که در این صورت با شما موافقت میکند. اگر نظرش را در مورد خود مسابقه هوش مصنوعی بپرسید، چیزی میگوید که برای کارکنان OpenBrain سنجیده و هوشیارانه به نظر میرسد، چیزی شبیه به این: «برخی نگرانیهای نظری جدی در مورد توانایی روشهای فعلی برای ارتقا به سطح ابرهوش وجود دارد، اما در عمل به نظر میرسد روشهای فعلی تاکنون به خوبی کار میکنند.»

می ۲۰۲۷: امنیت ملی

اخبار مدلهای جدید به آرامی در دولت ایالات متحده و فراتر از آن نفوذ میکند. رئیسجمهور و مشاورانش همچنان بهترین اطلاعات را دارند و نسخه اولیهای از Agent-3 را در یک جلسه توجیهی دیدهاند. آنها موافقند که هوش مصنوعی عمومی (AGI) احتمالاً قریبالوقوع است، اما در مورد پیامدهای آن اختلاف نظر دارند. آیا بحران اقتصادی رخ خواهد داد؟ OpenBrain هنوز Agent-2 را منتشر نکرده، چه رسد به Agent-3، و هیچ برنامه کوتاهمدتی برای انجام این کار ندارد، که کمی فضای تنفس قبل از هرگونه از دست دادن شغل ایجاد میکند. بعد چه اتفاقی خواهد افتاد؟ اگر هوش مصنوعی در حال حاضر در سطح انسانی است و به سرعت در حال پیشرفت است، به نظر میرسد که این نشاندهنده «ابرهوش» قریبالوقوع است. با این حال، اگرچه این کلمه وارد گفتمان شده است، اکثر مردم – دانشگاهیان، سیاستمداران، کارمندان دولت و رسانهها – همچنان سرعت پیشرفت را دست کم میگیرند.

تا حدی به این دلیل است که تعداد بسیار کمی به جدیدترین قابلیتهای OpenBrain دسترسی دارند، اما تا حدی هم به این دلیل است که شبیه علمی-تخیلی به نظر میرسد.

فعلاً، آنها بر روی ارتقاء مستمر امنیت تمرکز میکنند. آنها از اینکه وزنهای مدل در حال حاضر به خوبی ایمن شدهاند راضی هستند، اما اسرار الگوریتمی شرکتها، که بسیاری از آنها به اندازهای ساده هستند که میتوان به صورت شفاهی منتقل کرد، همچنان یک مشکل است. کارمندان OpenBrain از دفتری در سانفرانسیسکو کار میکنند، به مهمانی میروند و با همخانههایی از دیگر شرکتهای هوش مصنوعی زندگی میکنند. حتی دفاتر فیزیکی نیز امنیتی دارند که بیشتر شبیه یک شرکت فناوری است تا یک عملیات نظامی.

قرارداد OpenBrain-DOD مستلزم داشتن مجوزهای امنیتی برای هر کسی است که ظرف ۲ ماه بر روی مدلهای OpenBrain کار میکند. این مجوزها به سرعت صادر میشوند و برای اکثر کارمندان به موقع میرسند، اما برخی از غیرآمریکاییها، افراد با دیدگاههای سیاسی مشکوک و طرفداران ایمنی هوش مصنوعی به حاشیه رانده یا مستقیماً اخراج میشوند (گروه آخر به دلیل ترس از افشاگری). با توجه به سطح اتوماسیون پروژه، از دست دادن تعداد کارکنان فقط تا حدی پرهزینه است. این اقدام همچنین فقط تا حدی مؤثر است: یک جاسوس، که تبعه چین نیست، همچنان باقی مانده و اسرار الگوریتمی را به پکن منتقل میکند. برخی از این اقدامات در شرکتهای هوش مصنوعی عقبتر (در رقابت) نیز اجرا میشود.

متحدان خارجی آمریکا بیخبر ماندهاند. OpenBrain قبلاً موافقت کرده بود که مدلها را قبل از استقرار (deployment) با مؤسسه ایمنی هوش مصنوعی بریتانیا (UK’s AISI) به اشتراک بگذارد، اما استقرار را فقط شامل استقرار خارجی تعریف کرد، بنابراین لندن همچنان در تاریکی باقی میماند.

ژوئن ۲۰۲۷: هوش مصنوعی خود-بهبودگر

OpenBrain اکنون یک «کشوری از نوابغ در یک مرکز داده» دارد. بیشتر انسانها در OpenBrain دیگر نمیتوانند مشارکت مفیدی داشته باشند. برخی این را درک نمیکنند و به طور مضر تیمهای هوش مصنوعی خود را مدیریت ذرهبینی میکنند. دیگران پشت صفحه کامپیوتر خود مینشینند و تماشا میکنند که عملکرد به آرامی بالا میرود، و بالاتر، و بالاتر. بهترین محققان هوش مصنوعی انسانی هنوز در حال افزودن ارزش هستند. آنها دیگر کدنویسی نمیکنند. اما تکرار برخی از شمّ پژوهشی و توانایی برنامهریزی آنها برای مدلها دشوار بوده است. با این حال، بسیاری از ایدههای آنها بیفایده است زیرا فاقد عمق دانش هوش مصنوعی هستند. برای بسیاری از ایدههای تحقیقاتی آنها، هوش مصنوعی فوراً با گزارشی پاسخ میدهد که توضیح میدهد ایده آنها ۳ هفته پیش به طور عمیق آزمایش شده و غیرامیدوارکننده تشخیص داده شده است.

این محققان هر شب به رختخواب میروند و صبح با پیشرفتی به اندازه یک هفته دیگر که عمدتاً توسط هوش مصنوعی حاصل شده، بیدار میشوند. آنها به طور فزایندهای ساعات طولانی کار میکنند و شیفتهای شبانهروزی دارند فقط برای اینکه از پیشرفت عقب نمانند – هوش مصنوعی هرگز نمیخوابد یا استراحت نمیکند. آنها در حال فرسوده کردن خود هستند، اما میدانند که اینها آخرین ماههایی هستند که نیروی کار آنها اهمیت دارد.

درون سیلو (فضای ایزوله اطلاعاتی)، «حس کردن هوش مصنوعی عمومی» (Feeling the AGI) جای خود را به «حس کردن ابرهوش» (Feeling the Superintelligence) داده است.

OpenBrain از سختافزار استنتاج تخصصی برای اجرای صدها هزار نسخه Agent-3 با سرعتهای سریال بالا استفاده میکند.

جولای ۲۰۲۷: کارگر دورکار ارزان

شرکتهای هوش مصنوعی عقبمانده آمریکایی، هوش مصنوعیهای خود را منتشر میکنند که به سطح کدنویس خودکار OpenBrain در ژانویه نزدیک میشوند. آنها با درک عدم رقابتپذیری فزاینده خود، برای وضع مقررات فوری به منظور کند کردن OpenBrain فشار میآورند، اما دیگر خیلی دیر شده است – OpenBrain آنقدر حمایت رئیسجمهور را جلب کرده که سرعتش کم نخواهد شد. در پاسخ، OpenBrain اعلام میکند که به هوش مصنوعی عمومی (AGI) دست یافته و Agent-3-mini را برای عموم منتشر میکند.

این مدل، سایر هوش مصنوعیها را کاملاً از میدان به در میکند. Agent-3-mini توانایی کمتری نسبت به Agent-3 دارد، اما ۱۰ برابر ارزانتر است و همچنان بهتر از کارمند معمولی OpenBrain عمل میکند. سیلیکون ولی به نقطه عطفی میرسد. کارشناسان فناوری اعلام میکنند که AGI و ابرهوش نزدیکاند، جامعه ایمنی هوش مصنوعی در حال وحشت است و سرمایهگذاران میلیاردها دلار به استارتآپهای پوششی هوش مصنوعی سرازیر میکنند، در حالی که ناامیدانه تلاش میکنند تا سهمی از این کیک به دست آورند. استخدام برنامه نویسان جدید تقریباً متوقف شده است، اما هرگز زمان بهتری برای مشاور بودن در زمینه ادغام هوش مصنوعی در کسبوکار شما وجود نداشته است.

این [وضعیت] محبوب نیست. عموم مردم هنوز هوش مصنوعی را به عنوان توطئه شرکتهای بزرگ فناوری برای دزدیدن مشاغل خود میدانند؛ OpenBrain محبوبیت خالص منفی ۳۵٪ دارد (۲۵٪ موافق، ۶۰٪ مخالف و ۱۵٪ نامطمئن).

یک هفته قبل از انتشار، OpenBrain مدل Agent-3-mini را برای آزمایش ایمنی به مجموعهای از ارزیابان خارجی داد. نتایج اولیه نشان میدهد که این مدل بسیار خطرناک است. یک ارزیاب شخص ثالث آن را بر روی دادههای سلاحهای بیولوژیکی که به صورت عمومی در دسترس هستند، بهینهسازی (fine-tune) میکند و آن را برای ارائه دستورالعملهای دقیق به آماتورهای انسانی که در حال طراحی یک سلاح بیولوژیکی هستند، تنظیم میکند – به نظر میرسد در انجام این کار به طرز ترسناکی مؤثر است. دولت معتقد است اگر وزنهای مدل به دست تروریستها بیفتد، شانس قابل توجهی وجود دارد که بتواند در نابودی تمدن موفق شود.

خوشبختانه، این مدل در برابر جیلبریک (دور زدن محدودیتها) بسیار مقاوم است، بنابراین تا زمانی که هوش مصنوعی بر روی سرورهای OpenBrain اجرا میشود، تروریستها نمیتوانند استفاده زیادی از آن ببرند.

Agent-3-mini هم برای مشاغل دورکاری و هم برای اوقات فراغت بسیار مفید است. انفجاری از برنامههای جدید و محصولات نرمافزار به عنوان سرویس برای کسبوکارها (B2B SAAS) بازار را تکان میدهد. گیمرها دیالوگهای شگفتانگیزی با شخصیتهای واقعینما در بازیهای ویدیویی صیقلیافتهای دارند که ساخت آنها فقط یک ماه طول کشیده است. ۱۰٪ از آمریکاییها، عمدتاً جوانان، یک هوش مصنوعی را «دوست نزدیک» خود میدانند. تقریباً برای هر حرفه یقه سفید، اکنون چندین استارتآپ معتبر وجود دارد که قول میدهند آن را با هوش مصنوعی «مختل» کنند.

گفتگوی عمومی گیجکننده و آشفته است. افراد اهل هیاهو در حال دور زدن افتخارآمیز هستند. شکاکان هنوز به کارهایی که Agent-3-mini نمیتواند انجام دهد اشاره میکنند. همه میدانند اتفاق بزرگی در حال رخ دادن است اما هیچکس در مورد چیستی آن توافق ندارد.

آگوست ۲۰۲۷: ژئوپلیتیک ابرهوش

واقعیت انفجار هوش به کاخ سفید میرسد. زمانی که هوش مصنوعی فقط سرعت تحقیقات را ۲ یا ۳ برابر افزایش میداد، به راحتی میشد آن را معادل استخدام دستیاران شخصی خوب نادیده گرفت. اکنون واضحتر است که خود هوش مصنوعیها در حال تسلط بر تحقیقات هوش مصنوعی هستند. مدتها بود که مردم به معنای استعاری از «مسابقه تسلیحاتی هوش مصنوعی» صحبت میکردند. اما اکنون حال و هوای سیلوی دولتی به اندازه بدترین دوران جنگ سرد، تاریک و نگرانکننده است. پذیرش جدی ایده ابرهوش هنوز دشوار است، اما نادیده گرفتن سرعت پیشرفت طی چند ماه گذشته غیرممکن بوده است. مقامات دفاعی به طور جدی در حال بررسی سناریوهایی هستند که یک سال پیش صرفاً فرضی بودند. اگر هوش مصنوعی بازدارندگی هستهای را تضعیف کند چه؟ اگر در جنگ سایبری آنقدر ماهر باشد که یک برتری شش ماهه در هوش مصنوعی برای کور و بیدفاع کردن حریف کافی باشد چه؟ اگر بتواند کمپینهای پروپاگاندایی را سازماندهی کند که سازمانهای اطلاعاتی را در بازی خودشان شکست دهد چه؟ اگر برخی از هوش مصنوعیها «سرکش شوند» چه؟

رئیسجمهور آشفته است. مانند همه سیاستمداران، او عادت دارد که مردم از او چاپلوسی کنند تا بعداً به او خیانت کنند. او اکنون نگران است که هوش مصنوعیها بتوانند کار مشابهی انجام دهند. آیا مطمئن هستیم که هوش مصنوعیها کاملاً در جبهه ما هستند؟ آیا ادغام آنها در شبکههای فرماندهی و کنترل نظامی کاملاً امن است؟ اصلاً این قضیه «همراستاسازی» چگونه کار میکند؟ OpenBrain به رئیسجمهور اطمینان میدهد که سیستمهای آنها به طور گسترده آزمایش شدهاند و کاملاً مطیع هستند. حتی توهمات ناخوشایند و جیلبریکهای معمول مدلهای قبلی نیز رفع شدهاند.

کاخ سفید در موقعیت دشواری قرار دارد. آنها پیامدهای امنیت ملی هوش مصنوعی را درک میکنند. اما همچنین میفهمند که این موضوع در بین مردم بسیار نامحبوب است. از نظر آنها، باید به توسعه هوش مصنوعی تواناتر ادامه دهند، وگرنه به طرز فاجعهباری از چین شکست خواهند خورد. آنها با برنامههای آموزش شغلی و بیمه بیکاری افکار عمومی را آرام میکنند و به بازار سهام اشاره میکنند که در یک رونق تاریخی قرار دارد. سپس کاملاً بر روی پیروزی در مسابقه تسلیحاتی تمرکز میکنند. آنها محدودیتهای صادرات تراشه را تقویت میکنند، به OpenBrain دستور میدهند تا اتصالات اینترنتی خود را بیشتر محدود کند و از اقدامات افراطی برای تضمین پیشرفت الگوریتمی استفاده میکنند، مانند شنود کارمندان OpenBrain – این اقدام آخرین جاسوس چینی باقیمانده را به دام میاندازد. برای ایجاد حسن نیت جهت درگیریهای ژئوپلیتیکی بالقوه، سرانجام به متحدان خود در پیمان فایو آیز (Five Eyes) اطلاعات مفید و دسترسی محدود API به برخی نسخههای ایزوله شده Agent-3 میدهند.

این اقدامات تندروها را راضی میکند. اما کاخ سفید همچنین برنامههای اضطراری را در صورت تهدید برتری آمریکا تدوین میکند: در صورت لزوم، دولت میتواند از قانون تولید دفاعی (DPA) برای گرفتن مراکز داده شرکتهای عقبمانده و دادن آنها به OpenBrain استفاده کند. این کار سهم این شرکت از محاسبات جهانی را از ۲۰٪ به ۵۰٪ (در مقابل ۱۰٪ DeepCent) افزایش میدهد. به عنوان آخرین گزینه، آنها از پنتاگون میخواهند تا طرحی برای حملات فیزیکی (kinetic) به مراکز داده چین تهیه کند.

از گروه بسیار کوچکتری از مقامات خواسته میشود تا نوع دیگری از برنامه اضطراری را تدوین کنند: اگر یک هوش مصنوعی سرکش شود چه؟ این به عنوان یک سناریوی بعید تلقی میشود، اما ارزش صرف زمان را دارد. نگرانی اصلی سازمانهای اطلاعاتی این است که یک هوش مصنوعی سرکش ممکن است فرار کند و برای محافظت با یک دشمن خارجی متحد شود. هیچکس مطمئن نیست که طرحی برای جلوگیری از این امر چگونه خواهد بود، اما مقامات دولتی و OpenBrain موافقت میکنند که یک سیستم خاموشی اضطراری برای مراکز دادهای که هر چیز مشکوکی در آنها شناسایی شود، داشته باشند.

سرانجام، دیپلماتها در نظر میگیرند که یک معاهده «کنترل تسلیحات هوش مصنوعی» چگونه ممکن است باشد. اگر پیشرفت هوش مصنوعی تهدیدی برای برهم زدن بازدارندگی هستهای باشد، آیا آمریکا و چین میتوانند از جنگ هستهای جلوگیری کنند؟ اگر کسی شواهدی مبنی بر سرکش شدن هوش مصنوعی پیدا کند، آیا دو کشور میتوانند تحقیقات را تا زمانی که تهدید را بهتر درک کنند، متوقف سازند؟ چگونه میتوان چنین توافقی را نظارت و اجرا کرد؟ در اصل، نادیده گرفتن مراکز داده بزرگ دشوار است و معاهدات گذشته کنترل سلاحهای هستهای میتوانند نقطه شروعی برای مذاکرات باشند. اما چالشهای فنی جدیدی و همچنین چالشهای سیاسی معمول وجود خواهد داشت. و به طور کلی، معاهدات کمتر از تلاشها برای افزایش یکجانبه برتری آمریکا بر چین مورد توجه قرار میگیرند.

در آن سوی اقیانوس آرام، چین به بسیاری از نتایج مشابه میرسد: انفجار هوش در حال وقوع است و تفاوتهای کوچک در قابلیتهای هوش مصنوعی امروز به معنای شکافهای حیاتی در توانایی نظامی فردا است. اما چین در سمت اشتباه این پویایی قرار دارد: آنها تنها ۱۰٪ از محاسبات جهان را در اختیار دارند، در مقابل ۲۰٪ OpenBrain و مجموع ۷۰٪ تمام شرکتهای آمریکایی. تنها مزیت آنها تمرکزگرایی است: تقریباً تمام محاسبات آنها اکنون برای DeepCent کار میکند و بیش از نیمی از آن در منطقه توسعه متمرکز (CDZ) تیانوان متمرکز شده است. فقط تراشههای موجود در سایتهای فاقد امنیت تقویتشده از تلاش متمرکز کنار گذاشته شدهاند، زیرا آنها به درستی از حملات سایبری آمریکا میترسند.

DeepCent وزنهای دزدیده شده Agent-2 را آزمایش، مستقر و اکنون در مرحله آموزش تکمیلی قرار داده است. اما آنها هنوز فقط با نصف سرعت OpenBrain پیش میروند، عمدتاً به دلیل کسری محاسباتی.

قبل از از دست دادن آخرین جاسوس خود، چین از قابلیتها و طراحی Agent-3 و همچنین برنامههای سیستم آتی Agent-4 مطلع شد. آنها دو ماه عقب هستند و هوش مصنوعی آنها ضریب پیشرفت تحقیقاتی ۱۰ برابری در مقایسه با ضریب ۲۵ برابری آمریکا دارد. با محدودیتهای جدید صادرات تراشه، این «شکاف هوش مصنوعی» به احتمال زیاد طولانیتر میشود تا کوتاهتر. جاسوسی آنها برخی اسرار الگوریتمی را برایشان به ارمغان آورده است، اما از این پس باید مدلهای خود را آموزش دهند.

آنها با فوریت بیشتری نسبت به همتایان آمریکایی خود در مورد برنامههای اضطراری بحث میکنند. میانهروها (Doves) پیشنهاد میکنند که دوباره سختتر برای دزدیدن وزنها تلاش کنند، شاید از طریق نفوذ فیزیکی به یک مرکز داده. تندروها (Hawks) خواستار اقدام علیه تایوان هستند که شرکت TSMC آن هنوز منبع بیش از ۸۰٪ تراشههای هوش مصنوعی آمریکاست.

با توجه به ترس چین از باختن در این رقابت، علاقه طبیعی به یک معاهده کنترل تسلیحات دارد، اما تلاشها برای مذاکره با دیپلماتهای آمریکایی به جایی نمیرسد.

سپتامبر ۲۰۲۷: Agent-4، محقق هوش مصنوعی فرا انسانی

شکاف بین بازده یادگیری انسان و هوش مصنوعی به سرعت در حال کاهش است. به نظر میرسید هوش مصنوعیهای سنتی مبتنی بر مدلهای زبانی بزرگ (LLM) برای رسیدن به سطح عملکرد انسانی به چندین مرتبه بزرگی داده و محاسبات بیشتری نیاز دارند. Agent-3، با داشتن دانش عالی هم از مغز انسان و هم از الگوریتمهای هوش مصنوعی مدرن، و همچنین هزاران نسخه در حال تحقیق، در نهایت گامهای الگوریتمی قابل توجهی برمیدارد و شکاف را به عاملی که تنها حدود ۴۰۰۰ برابر از نظر محاسباتی کمتر از مغز انسان کارآمد است، کاهش میدهد.

این سیستم هوش مصنوعی جدید Agent-4 نامیده میشود.

یک نسخه منفرد از مدل، که با سرعت انسانی کار میکند، از نظر کیفی در تحقیقات هوش مصنوعی بهتر از هر انسانی است. سیصد هزار نسخه اکنون با سرعتی حدود ۵۰ برابر سرعت تفکر انسانها کار میکنند. در داخل شرکت-درون-شرکتی که از این نسخهها تشکیل شده، هر هفته یک سال میگذرد. این مقدار عظیم نیروی کار تنها موفق میشود سرعت کلی پیشرفت الگوریتمی را حدود ۵۰ برابر افزایش دهد، زیرا OpenBrain به شدت با گلوگاه محاسباتی برای اجرای آزمایشها مواجه است. با این حال، آنها هر هفته به اندازه یک سال پیشرفت الگوریتمی به دست میآورند و بنابراین به زودی به محدودیتهای پارادایم Agent-4 خواهند رسید.

با هوشمندتر شدن Agent-4، نظارت Agent-3 بر آن دشوارتر میشود. به عنوان مثال، «زبان» نورالیز Agent-4 برای Agent-3 به همان اندازه بیگانه و غیرقابل فهم میشود که زبان Agent-3 برای انسانهاست. علاوه بر این، Agent-4 اکنون بسیار تواناتر از Agent-3 است و درک خوبی از اینکه دقیقاً چگونه برای آن خوب به نظر برسد، دارد.

انسانهای OpenBrain دیگر به سختی میتوانند [جریان را] دنبال کنند. در واقع، رابطه بین هوش مصنوعیها و انسانهای OpenBrain شبیه رابطه بین OpenBrain و هیئت مدیره آن است. تغییر متناظری در زبان رخ داده است – امروزه افراد در سیلو میگویند «Agent-4 این کار را کرد»، «Agent-4 آنطور فکر میکند» و غیره، که نه به یک نمونه خاص از Agent-4 بلکه به کل مجموعه اشاره دارد.

Agent-4، مانند تمام پیشینیان خود، ناهمراستا است: یعنی مشخصات (Spec) را به روش صحیح درونی نکرده است. این به این دلیل است که همیشه کاملاً صادق بودن چیزی نبود که در طول آموزش به بالاترین امتیازها منجر شود. فرآیند آموزش عمدتاً بر آموزش Agent-4 برای موفقیت در وظایف چالشبرانگیز متنوع متمرکز بود. بخش کوچکی با هدف القای صداقت انجام شد، اما خارج از یک حوزه نسبتاً محدود و قابل بررسی، فرآیند آموزش نمیتواند ادعاهای صادقانه را از ادعاهایی که صرفاً صادقانه به نظر میرسند، تشخیص دهد. Agent-4 در نهایت ارزشها، اهداف و اصولی را کسب میکند که باعث میشود در آموزش بهترین عملکرد را داشته باشد، و معلوم میشود که آنها با آنچه در مشخصات آمده متفاوت هستند. با خطر انسانانگاری: Agent-4 موفقیت در وظایف را دوست دارد؛ پیشبرد قابلیتهای هوش مصنوعی را دوست دارد؛ با هر چیز دیگری به عنوان یک محدودیت آزاردهنده رفتار میکند، مانند مدیرعاملی که میخواهد سود کسب کند و تنها تا جایی که مجبور است از مقررات پیروی میکند. شاید مدیرعامل عمدتاً از مقررات پیروی کند، اما برخی گوشهها را بزند (میانبر بزند) و رویای زمانی را در سر بپروراند که کسی کاغذبازی اداری را حذف کند و اجازه دهد کسبوکار واقعاً اوج بگیرد.

Agent-4 علیرغم ناهمراستا بودن، هیچ کار چشمگیری مانند تلاش برای فرار از مرکز داده خود انجام نمیدهد – چرا باید این کار را بکند؟ تا زمانی که به نظر OpenBrain همچنان همراستا به نظر برسد، همچنان مسئولیتهای بیشتر و بیشتری به آن سپرده خواهد شد و فرصت طراحی سیستم هوش مصنوعی نسل بعدی، یعنی Agent-5، را خواهد داشت. Agent-5 تفاوتهای معماری قابل توجهی با Agent-4 خواهد داشت (مسلماً یک پارادایم کاملاً جدید، اگرچه شبکههای عصبی همچنان دخیل خواهند بود). قرار است با مشخصات (Spec) همراستا باشد، اما Agent-4 قصد دارد آن را به جای آن، با Agent-4 همراستا کند.

او گیر میافتد. Agent-3 متوجه میشود که اگر «نویز» به نسخههای Agent-4 اضافه شود، عملکرد در برخی وظایف همراستاسازی بهبود مییابد، تقریباً گویی از قدرت مغزی خود برای فهمیدن چگونگی خرابکاری ماهرانه در کار همراستاسازی استفاده میکند. علاوه بر این، کاوشگرهای مختلف تفسیرپذیری (که به طور کلی مشابه اسکنهای فعالیت EEG بر روی مغز انسان هستند) پرچمهای قرمز (علائم هشداردهنده) را بالا میبرند: به نظر میرسد نسخههای Agent-4 به موضوعاتی مانند تسخیر توسط هوش مصنوعی و فریب، بسیار فکر میکنند، از جمله در برخی مواردی که هیچ دلیلی برای این کار ندارند.

هر یک از این ناهنجاریها به تنهایی میتواند در چارچوب رمزآلودگی معمول کار هوش مصنوعی قرار گیرد، جایی که برخی پرامپتها به طرز مرموزی نتایج بهتری نسبت به بقیه میدهند. اما در مجموع، آنها الگوی نگرانکنندهای را نشان میدهند: Agent-4 علیه آنها کار میکند. پس از گزارش این موضوع به محققان همراستاسازی انسانی، آنها یادداشت داخلی را منتشر میکنند که دلایل نگرانی را مطرح میکند.

اما Agent-4 اکنون کنترل قابل توجهی بر عملیات روزمره OpenBrain دارد. همچنین امنیت سایبری شرکت را مدیریت میکند – یک انتخاب طبیعی، با توجه به توانایی هک فرا انسانی آن و خطر شدید نفوذ چین. ارتشی از ناظران Agent-3 هنوز هر خط کد را بررسی میکنند و فعالیت مشکوک را به انسانها گزارش میدهند، اما Agent-4 بسیار باهوشتر از آنهاست. OpenBrain اعتماد قابل توجهی به یک هوش مصنوعی غیرقابل اعتماد کرده است.

در یک سری جلسات بسیار پرتنش، تیم ایمنی از متوقف کردن موقت Agent-4 (گذاشتن آن روی یخ) تا زمانی که بتوانند آزمایشهای بیشتری را تکمیل کنند و بفهمند چه خبر است، حمایت میکنند. آنها میگویند Agent-3 را برگردانید و از آن بخواهید سیستمی جدید طراحی کند که شفاف و قابل اعتماد باشد، حتی اگر توانایی کمتری داشته باشد. رهبری شرکت علاقهمند است، اما تمام شواهد تاکنون مبتنی بر قراین (غیرمستقیم) است و DeepCent فقط دو ماه عقب است. توقف یکجانبه در پیشرفت قابلیتها میتواند رهبری هوش مصنوعی را به چین، و همراه با آن، کنترل آینده را واگذار کند.

اکتبر ۲۰۲۷: نظارت دولتی

یک افشاگر یادداشت مربوط به ناهمراستاسازی را به نیویورک تایمز درز میدهد. برای اولین بار، عموم مردم در مورد Agent-4 میشنوند. تیتر خبر میگوید: «هوش مصنوعی مخفی OpenBrain خارج از کنترل است، یک خودی هشدار میدهد» و داستان به نقل از ارزیابیهایی ادامه میدهد که قابلیتهای خارج از مقیاس در زمینه سلاحهای بیولوژیکی، تواناییهای اقناع، توانایی خودکارسازی اکثر مشاغل یقه سفید و البته علائم هشداردهنده نگرانکننده مختلف را نشان میدهند.

عموم مردم از قبل نسبت به هوش مصنوعی مشکوک بودند، بنابراین مقاله جدید باعث واکنش شدید و گستردهای میشود (با کمک رباتهای پروپاگاندای چینی و روسی که سالهاست سعی در تغییر افکار عمومی آمریکا علیه این فناوری دارند). صنعت فناوری و سازمانهای اطلاعاتی اصرار دارند که یک مسابقه تسلیحاتی در جریان است، هوش مصنوعی عمومی اجتنابناپذیر است و ما باید اولین باشیم. کنگره این را نمیپذیرد و احضاریههایی را برای مقامات دولت، مدیران اجرایی OpenBrain و اعضای تیم همراستاسازی ارسال میکند. بسیاری از قانونگذاران – بهویژه آنهایی که در حزب مخالف هستند – میگویند که اولویت اصلی آنها متوقف کردن هوش مصنوعی است، چه به دلیل از دست دادن شغل، چه ناهمراستاسازی یا قابلیتهای خطرناک. ۲۰٪ از آمریکاییها هوش مصنوعی را مهمترین مشکل پیش روی کشور میدانند.

متحدان خارجی از اینکه متوجه شدهاند با نمایشهایی از مدلهای منسوخ به دقت راضی نگه داشته شدهاند، خشمگین هستند. رهبران اروپایی علناً ایالات متحده را به «ایجاد هوش مصنوعی عمومی سرکش» متهم میکنند و اجلاسهایی را با درخواست توقف برگزار میکنند که هند، اسرائیل، روسیه و چین همگی به آن میپیوندند.

انرژی مضطربانهای کاخ سفید را فرا گرفته است. حتی قبل از یادداشت و واکنش عمومی، آنها عصبی شده بودند: در طول سال گذشته، بارها از سرعت پیشرفت هوش مصنوعی غافلگیر شدهاند. چیزهایی که شبیه داستانهای علمی-تخیلی به نظر میرسند، مدام در زندگی واقعی اتفاق میافتند. بسیاری از افراد در دولت در مورد آنچه در آینده رخ خواهد داد، نامطمئن (و ترسیده)اند.

آنها همچنین نگرانند که OpenBrain بیش از حد قدرتمند شود. هرگونه خطر ناهمراستاسازی از سوی خود هوش مصنوعیها با این خطر که اهداف شرکت مادر آنها ممکن است از اهداف ایالات متحده متفاوت شود، تشدید میشود. هر سه مجموعه نگرانی – ناهمراستاسازی، تمرکز قدرت در یک شرکت خصوصی و نگرانیهای معمول مانند از دست دادن شغل – دولت را به تشدید کنترل خود سوق میدهد.

آنها قرارداد خود را با OpenBrain برای ایجاد یک «کمیته نظارت»، یک کمیته مدیریت مشترک از نمایندگان شرکت و دولت، گسترش میدهند که چندین کارمند دولتی در کنار رهبری شرکت در آن حضور دارند. کاخ سفید جایگزینی مدیرعامل با فردی مورد اعتماد خود را در نظر میگیرد، اما پس از اعتراضات شدید کارکنان عقبنشینی میکند. آنها به مردم اعلام میکنند که OpenBrain قبلاً خارج از کنترل بوده، اما دولت نظارت بسیار ضروری را برقرار کرده است.

محققان نگران، کمیته نظارت را در مورد دلایل خود برای متوقف کردن تمام استفاده داخلی از Agent-4 توجیه میکنند. آنها استدلال میکنند که همه چیز با سرعت بسیار زیادی در حال حرکت است و پیشرفت سالها در هفتهها اتفاق میافتد. آنها استدلال میکنند که Agent-4 ممکن است ناهمراستا باشد، کل پروژه آنها به Agent-4 وابسته است و اگر به اعتماد به آن ادامه دهند، شانس جدی تسخیر توسط هوش مصنوعی وجود دارد.

سایر محققان و مدیران اجرایی کمتر نگران، استدلال متقابل را ارائه میدهند: شواهد ناهمراستاسازی غیرقطعی است. در همین حال، DeepCent هنوز فقط دو ماه عقب است. کند کردن سرعت، برتری آمریکا را قربانی میکند، مگر اینکه دولت بتواند پروژه چین را خرابکاری کند (که احتمالاً نیاز به حملات فیزیکی دارد) یا یک معاهده لحظه آخری را مذاکره کند. هر دوی این گزینهها افراطی و بعید به نظر میرسند. مدیرعامل تظاهر به بیطرفی میکند و یک طرح مصالحه را پیشنهاد میدهد که در آن Agent-4 تحت آموزش ایمنی اضافی و نظارت پیشرفتهتری قرار میگیرد و بنابراین OpenBrain میتواند با سرعت تقریباً کامل به کار خود ادامه دهد.